Techmax 39: KI in der Wissenschaft

plus Shipping Costs

Mit künstlicher Intelligenz Neues entdecken

Forschende machen sich neugierig und motiviert auf die Suche nach neuem Wissen. Und mit einer guten Portion Kreativität und Ausdauer können sie Neues entdecken und verstehen. Künstliche Intelligenz ist zunehmend ein wichtiges Hilfsmittel, um dieses Ziel zu erreichen. Doch könnte die KI auch selbst als Wissenschaftlerin agieren, zu Erkenntnissen gelangen oder Ideen, Konzepte und echtes Verständnis entwickeln?

Noch nicht einmal fünf Jahre alt und schon das Abitur gut bestanden: Deutsch 2, Geschichte 2, Mathe 2, Ethik 2, Informatik 2. Die Hochbegabte: die künstliche Intelligenz (KI) ChatGPT, die auf einem großen Sprachmodell (large language model, LLM) basiert. Und wie sich anhand von Aufgaben aus dem bayerischen Abitur zeigte, war die 2023 verfügbare Version GPT-4 bereits so weit entwickelt, dass sie als gute Schülerin durchging und die allgemeine Hochschulreife zugesprochen bekam. Doch bedeutet das, dass die KI tatsächlich intelligent ist, oder plappert sie nur wie ein gut trainierter Papagei die richtigen Phrasen im richtigen Moment? Dass sie bekanntes Wissen korrekt und verständlich wiedergeben kann, hat KI schon gezeigt. Aber kann sie auch für die menschliche Intelligenz entscheidende Eigenschaften wie Neugier, Motivation und Kreativität entwickeln, Aufgaben eigenständig bearbeiten und sich eine eigene Meinung bilden? Mit diesen Fragen beschäftigt sich der Physiker Mario Krenn. Am Max-Planck-Institut für die Physik des Lichts und an der Eberhard Karls Universität Tübingen arbeitet er an einer KI, die Wissenschaftlerinnen und Wissenschaftler unterstützt oder sogar eigenständig forscht.

Neue Lösungen für Experimente

Zu dieser Forschung gelangte Krenn über die Quantenoptik. Im Jahr 2014 arbeitete er als Doktorand im Labor des späteren Nobelpreisträgers Anton Zeilinger in Wien daran, in komplexen optischen Aufbauten Lichtteilchen mit besonderen Eigenschaften herzustellen. Doch an einer Aufgabe biss Krenn sich monatelang die Zähne aus. Zusammen mit weiteren Forschenden versuchte er sich einen experimentellen Aufbau zu überlegen, der Lichtteilchen herstellt, die eine ganz bestimmte Beziehung zueinander haben. Egal wie er Laser, Linsen, Spiegel, Kristalle und Detektoren in seinen Gedankenexperimenten, Skizzen und Berechnungen anordnete, das erwünschte Ergebnis blieb aus. Also entschied Krenn sich dazu, ein Computerprogramm zu entwickeln, das sich auf die Suche nach der Lösung für sein Problem machen sollte. Dazu stattete er das Programm mit physikalischem Grundwissen aus und stellte alle optischen Bauteile virtuell zur Verfügung. „Damals wie heute setzen wir dazu sogenannte Explorationsalgorithmen ein, die den riesigen abstrakten Raum an Kombinationen sehr effizient auf neue Lösungen durchsuchen“, sagt Krenn. Melvin, wie Krenn sein Programm taufte, simulierte also Millionen von Kombinationen der Bauelemente und hatte damit schnell Erfolg. „Das war ein verrückter Tag. Ich konnte das gar nicht glauben. Das Programm hatte in ein paar Stunden eine Lösung gefunden, nach der drei experimentelle und ein theoretischer Physiker monatelang gesucht hatten“, erzählt Krenn. Anschließend sorgte er dafür, dass Melvin dazulernen konnte. Dank eines Algorithmus des maschinellen Lernens erinnert sich das Programm an bereits simulierte Aufbauten und versucht, diese für die Lösung des neuen Problems wiederzuverwerten.

Ausgehend von diesem Erfolg untersucht Krenn, wie KI der Forschung helfen und zu neuen Erkenntnissen beitragen kann. Schon heute ist KI ein wichtiges Hilfsmittel: So kann beispielsweise AlphaFold, das auf tiefen neuronalen Netzen basiert, eine Proteinstruktur auf Grundlage der Aminosäuresequenz vorhersagen. Dies ermöglicht es, genau auf eine Anwendung zugeschnittene Proteine herzustellen. Und deren Potenzial ist riesig, etwa in der Medizin oder chemischen Industrie. Doch neues Verständnis hat AlphaFold bisher nicht produziert. So sagt das Programm zwar voraus, wie die Struktur eines Proteins einer bestimmten Aminosäuresequenz aussieht, erklärt aber nicht, warum es diese Form annimmt oder wie die Faltung abläuft.

Maschinen forschen mit

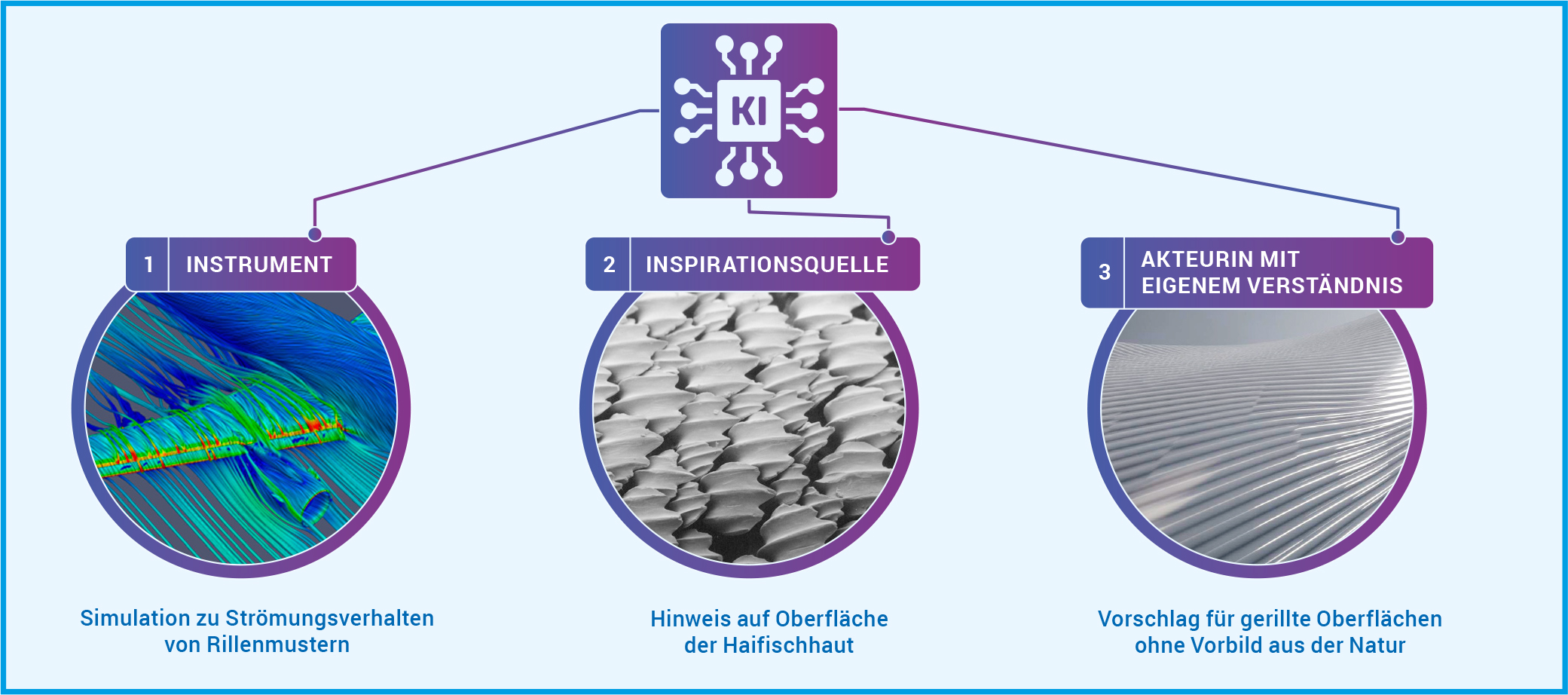

Krenn wünscht sich aber eine KI, die mehr ist als eine Blackbox, die ein Ergebnis produziert. Daher untersucht er, wie KI auf unterschiedlichen Ebenen zu neuem Verständnis beitragen kann (Abb. A). In der ersten Dimension dient KI als Instrument, das Eigenschaften eines Systems aufdeckt, die sonst nur schwer oder gar nicht zu ergründen sind. Menschen können aus diesen Erkenntnissen dann wissenschaftliches Verständnis entwickeln. Dies gilt vor allem für die Simulation von natürlichen Prozessen, die auf Längen- und Zeitskalen ablaufen, die im Experiment nicht wahrnehmbar sind. In der zweiten Dimension dient die KI als Inspirationsquelle für neue Konzepte und Ideen, die menschliche Forschende verstehen und verallgemeinern können. So kann die KI Überraschungen in Datensätzen oder der Literatur finden. Oder unerwartete Konzepte entdecken, indem sie wissenschaftliche Modelle untersucht oder mit einprogrammierter Neugier oder Kreativität einen Datenraum exploriert. Und auch wenn die KI Lösungen für bestimmte Probleme beziehungsweise Aufgaben in interpretierbarer Form ausgibt, kann sie als Inspirationsquelle für die Entdeckung neuer Konzepte dienen. In diesen ersten beiden Dimensionen ermöglicht die KI also dem Menschen, neue wissenschaftliche Erkenntnisse zu gewinnen. In der dritten Dimension gewinnt die Maschine selbst neue Erkenntnisse und damit Verständnis und kann dieses auch weitergeben. In diese Dimension ist KI bisher nicht vorgedrungen.

Abb. A: KI kann auf drei Dimensionen zu neuem Verständnis beitragen. [ 1 ] Als Instrument, das Eigenschaften eines physikalischen Systems aufdeckt, die sonst nur schwer oder gar nicht zu ergründen sind. Bei der Haifischhaut hätte eine KI durch Simulationen die Experimente in einem Strömungskanal ersetzen können. [ 2 ] Als Inspirationsquelle, die überraschende Ideen und Konzepte findet. Die KI hätte etwa Forschende aus der Luft- und Raumfahrt auf die Beobachtungen des Wirbeltierforschers aufmerksam machen können, der die Rillen auf den Haifischschuppen entdeckte. [ 3 ] Als Agentin des Verständnisses, die selbst in der Lage ist, wissenschaftliches Verständnis zu entwickeln und weiterzugeben. So eine Agentin hätte auch ohne das biologische Vorbild der Haifischhaut auf derartige Rillen kommen können, um den Strömungswiderstand von Flugzeugen zu reduzieren.

© DLR (CC BY-NC-ND 3.0), Pascal Deynat/Odontobase (CC BY-SA 3.0), MPG (CC BY-NC-SA 4.0)

Algorithmen erzeugen Forschungsfragen

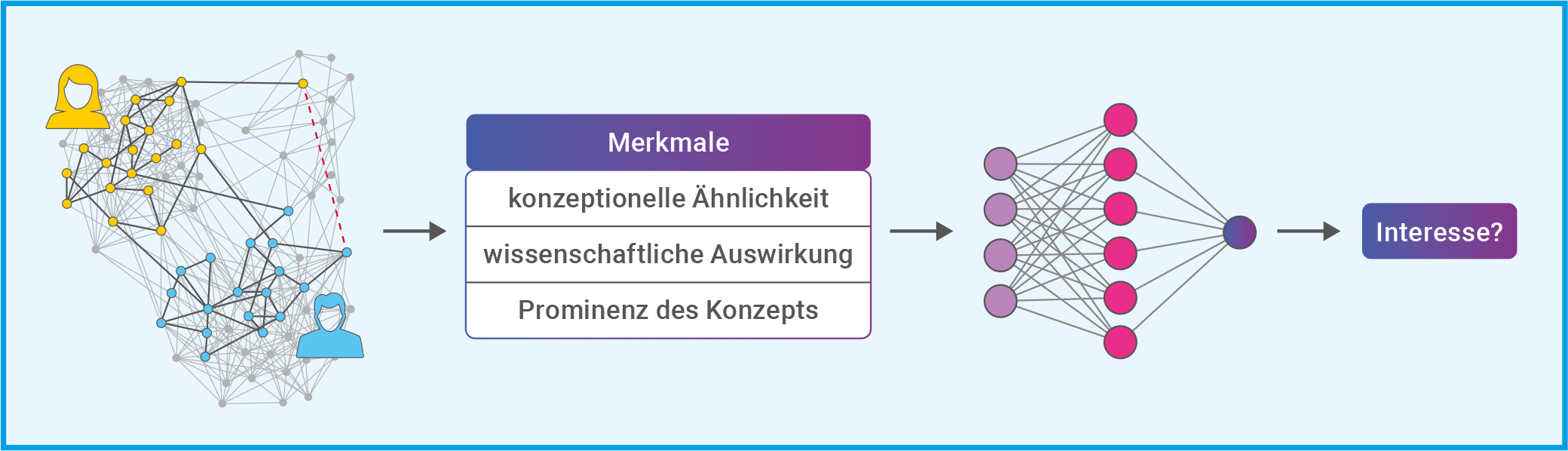

Mario Krenn arbeitet aktuell an einer KI als Inspirationsquelle. Zusammen mit seiner Kollegin Xuemei Gu entwickelte er SciMuse, die Wissenschafts-Muse: Ein System, das neue, personalisierte Forschungsideen vorschlägt. Dazu stützten sich die Forschenden einerseits auf GPT-4 und setzten andererseits auf einen selbst entwickelten Wissensgraphen (Abb. B). Der Wissensgraph enthält Informationen zum Inhalt und Einfluss von mehr als 58 Millionen wissenschaftlichen Artikeln. Während der Entwicklung von SciMuse nutzten die Forschenden entweder eine Kombination aus ihrem Wissensgraphen und GPT-4 oder GPT-4 alleine, um Forschungsvorschläge zu generieren. Dabei beinhalteten die Prompts für GPT-4 die Aufforderung zur Selbstreflexion: GPT-4 sollte drei Ideen entwickeln, reflektieren und zweimal verbessern. Und dann die am besten geeignete Projektidee als Endergebnis auswählen. Eine derartige Selbstreflexion ist in zahlreichen aktuellen LLM-KIs bereits enthalten, so auch in der GPT-4 Nachfolgerin o3. Diese sogenannten Reasoning-Modelle überprüfen ihre eigenen Ergebnisse schrittweise, bevor sie eine Antwort geben.

Abb. B: Im Wissensgraphen (links) repräsentieren die Kreise (Eckpunkte) wissenschaftliche Konzepte. Und jedes Mal, wenn zwei Konzepte gemeinsam in einem Titel oder der Zusammenfassung einer wissenschaftlichen Arbeit erscheinen, wird eine Verbindungslinie (Kante) gezogen. Der gelbe und der blaue Teilgraph repräsentieren die Arbeit zweier Forschender, für die ein gemeinsamer Forschungsvorschlag gesucht wird. Die Merkmale der Konzepte im Wissensgraphen (Mitte) beeinflussen das Interesse an den Forschungsvorschlägen erheblich. Auf Grundlage dieser Daten wurde ein maschinelles Lernmodell trainiert, um den Grad des Interesses allein auf der Grundlage dieser Eigenschaften vorherzusagen. Als Lernmodell wurde ein kleines neuronales Netz (rechts) mit einer verborgenen Schicht und einem Ausgabeneuron genutzt (s. Techmax 34, Abb. B).

© Verändert nach: Gu & Krenn (2024): Generation and human-expert evaluation of interesting research ideas using knowledge graphs and large language models; OpenReview.net / CC BY 4.0

Krenn und Gu legten im nächsten Schritt einhundert erfahrenen Max-Planck-Forschenden die KI-generierten, personalisierten Forschungsvorschläge vor. In einer Umfrage bewerteten diese das Interessensniveau der Vorschläge. Die Ergebnisse zeigten, dass die Forschungsvorschläge, die mittels einer Kombination von Wissensgraph plus GPT-4 erstellt wurden, nicht besser abschnitten als jene, die von GPT-4 alleine erzeugt wurden. Doch anhand der Bewertungen konnten die Forschenden klare Zusammenhänge zwischen Interessensniveau des Forschungsvorschlags und Eigenschaften nachweisen, die die zugrunde liegenden Konzepte im Wissensgraphen aufwiesen (Abb. B). Anhand dieser Zusammenhänge trainierte Krenns Team ein kleines neuronales Netz für die Vorhersage des Forschungsinteresses allein aus Daten des Wissensgraphen. Damit hatten sie die KI mit einem Gefühl für spannende Forschungsthemen ausgestattet und so SciMuse geschaffen. Dank dieses Gefühls kann SciMuse neue und hochinteressante Forschungsthemen aus Wissensgraphen auswählen und mit Hilfe moderner großer Sprachmodelle vollwertige Forschungsvorschläge formulieren.

Große Sprachmodelle

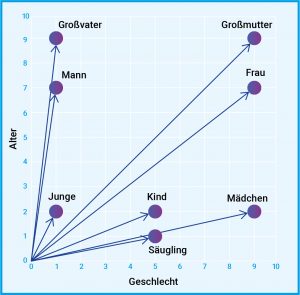

GPT-4 konnte Krenns Team nicht auf die gleiche Weise mit Gefühl ausstatten. Denn während sie im selbst entwickelten Wissensgraphen bestimmte Eigenschaften ausmachen konnten, die das Interessensniveau beeinflussen, haben sie keinen Einblick in die Arbeitsweise von GPT-4. LLMs wie GPT-4 sind meist eine Blackbox, die so komplex ist, dass niemand genau versteht, wie sie auf ihre Ergebnisse kommt. Ein LLM basiert auf einem künstlichen neuronalen Netz, das auf die Verarbeitung und Erzeugung von natürlicher Sprache spezialisiert ist. Ein oftmals genutzter Ansatz, um ein LLM zu erzeugen, ist der generative vortrainierte Transformer (generative pre-trained transformer, GPT). Dieser ist darauf spezialisiert, Text zu verarbeiten und zu erzeugen. Dabei wird Text in numerische Repräsentationen (Token) umgewandelt. Jedes Token wird gemäß einer Worteinbettungstabelle (word embedding) in einen Vektor umgewandelt und so in Kontext gesetzt (Abb. C). Das künstliche neuronale Netz trainiert bei GPTs auf riesigen Datensätzen unmarkierten Textes (unüberwachtes Lernen). Zur Feinabstimmung wird überwachtes Lernen und Verstärkungslernen durch menschliches Feedback eingesetzt.

Abb. C: In der natürlichen Sprachverarbeitung ist eine Worteinbettung eine Darstellung eines Wortes. In der Regel handelt es sich bei der Darstellung um einen Vektor, der die Bedeutung des Wortes so kodiert, dass bei Wörtern, die im Vektorraum näher beieinander liegen, eine ähnliche Bedeutung zu erwarten ist. Der Vektor kann dabei vieldimensional sein, hier ist ein Beispiel in 2D dargestellt. Dabei werden Wörter gemäß ihrer Bedeutung in die Dimensionen Alter und Geschlecht eingeordnet.

© MPG

Wann forscht KI besser als wir?

Aktuelle große Sprachmodelle wirken schon erstaunlich intelligent. Im Fall der Reasoning-Modelle sprechen einige Fachleute sogar davon, dass diese Modelle nun logisch denken können. Kritiker bezweifeln dies und sehen den Schritt hin zur allgemeinen künstlichen Intelligenz (artificial general intelligence, AGI) noch in weiter Ferne. Unter AGI versteht man eine KI, die eigene Schlüsse zieht, sowie Bekanntes und Gelerntes auf neue Felder übertragen kann. Außerdem sollte eine AGI in einer natürlichen, das heißt einer komplexen und offenen Umgebung zurechtkommen. Wenn es um die Bewertung der Intelligenz einer KI geht, wird es schnell philosophisch. Denn es ist nicht ganz klar, was intelligent genau bedeutet. Schon heute überflügeln KIs den Menschen in zahlreichen Kategorien des rationalen Denkens. Doch bisher scheitern KIs daran, auf unerwartete Veränderungen zu reagieren oder ihr Gelerntes auf Gebiete anzuwenden beziehungsweise zu übertragen, die nicht ihrem Training entsprechen. Eine KI, die selbst als Wissenschaftlerin agieren soll, müsste genau das schaffen, um neue Erkenntnisse zu gewinnen und Verständnis zu entwickeln. Denn Verständnis setzt eine intuitive, modell- oder bildhafte Vorstellung eines wissenschaftlichen Zusammenhangs voraus. Diese Vorstellung ermöglicht es dann, qualitative Aussagen zu treffen, ohne genaue Berechnungen anzustellen.

Für die KI als Wissenschaftlerin sind außerdem auch Neugier, Kreativität und Motivation wichtig. Dazu braucht sie eine Beziehung zur realen Welt. Denn um spannende, das heißt bedeutende Probleme beziehungsweise Fragen zu identifizieren, muss sie wissen, was ihr selbst oder für die ganze Menschheit wichtig ist. Dieses sogenannte Weltwissen ist bei KIs bisher wenig ausgeprägt. Das liegt an den eingeschränkten Trainingsdaten, die KIs bisher zum Lernen nutzen. Zwar könnte man bei großen Sprachmodellen wie ChatGPT davon sprechen, dass sie sich durch die enorme Anzahl an verarbeiteten Texten Weltwissen angeeignet haben. Doch auch ihnen fehlt der vieldimensionale Bezug zur Welt, weil sie im Gegensatz zum Menschen keine verkörperten Intelligenzen sind: Sie können nicht physisch mit der realen Welt interagieren und auch nur sehr eingeschränkt Sinneseindrücke sammeln. Während also ein Mensch sowohl Auto fahren als auch wissenschaftliche Erkenntnisse gewinnen kann, ist dies für KIs momentan noch eine Herausforderung.

Mario Krenn bewertet die Fähigkeiten von KI als Wissenschaftlerin aktuell so: „Wir sind jetzt auf dem Niveau, auf dem wir Ideen erzeugen können. Und bei bestimmten Themen können unsere KI-Systeme bereits vollkommen neue Lösungen für wissenschaftliche Fragestellungen finden!“ Für die Zukunft ist er optimistisch und hofft, dass die KI ihre menschlichen Kolleginnen und Kollegen auf der Suche nach neuen Erkenntnissen bald kräftig unterstützt.

Abbildungshinweise:

Titelbild: © istockphoto.com / berya113

Abb. A: © DLR (CC BY-NC-ND 3.0), Pascal Deynat/Odontobase (CC BY-SA 3.0), MPG (CC BY-NC-SA 4.0)

Abb. B: © Verändert nach: Gu & Krenn (2024): Generation and human-expert evaluation of interesting research ideas using knowledge graphs and large language models; OpenReview.net / CC BY 4.0

Abb. C: © MPG

Der Text wird unter CC BY-NC-SA 4.0 veröffentlicht.

TECHMAX Ausgabe 39, August 2025; Text: Dr. Andreas Merian; Redaktion: Dr. Tanja Fendt